Wednesday, October 19. 2016

Le médium spirite ou la magie dun corps hypermédiatique à lère de la modernité | #spirit #media #technology

Note: following the previous post that mentioned the idea of spiritism in relation to personal data, or forgotten personal data, but also in relation to "beliefs" linked to contemporary technologies, here comes an interesting symposium (Machines, magie, médias) and post on France Culture. The following post and linked talk from researcher Mireille Berton (nearby University of Lausanne, Dpt of Film History and Aesthetics) are in French.

Via France Culture

-----

Cerisy : Machines, magie, médias (du 20 au 28 août 2016)

Les magiciens — de Robert-Houdin et Georges Méliès à Harry Houdini et Howard Thurston suivis par Abdul Alafrez, David Copperfield, Jim Steinmeyer, Marco Tempest et bien d’autres — ont questionné les processus de production de l’illusion au rythme des innovations en matière d’optique, d’acoustique, d’électricité et plus récemment d’informatique et de numérique.

Or, toute technologie qui se joue de nos sens, tant qu’elle ne dévoile pas tous ses secrets, tant que les techniques qu'elle recèle ne sont pas maîtrisées, tant qu’elle n’est pas récupérée et formalisée par un média, reste à un stade que l’on peut définir comme un moment magique. Machines et Magie partagent, en effet, le secret, la métamorphose, le double, la participation, la médiation. Ce parti pris se fonde sur l’hypothèse avancée par Arthur C. Clarke : "Toute technologie suffisamment avancée est indiscernable de la magie" (1984, p. 36).

L’émergence même des médias peut être analysée en termes d’incarnation de la pensée magique, "patron-modèle" (Edgar Morin, 1956) de la forme première de l’entendement individuel (Marcel Mauss, 1950). De facto, depuis les fantasmagories du XVIIIe siècle jusqu’aux arts numériques les plus actuels, en passant par le théâtre, la lanterne magique, la photographie, le Théâtrophone, le phonographe, la radio, la télévision et le cinéma, l’histoire des machineries spectaculaires croise celle de la magie et les expérimentations de ses praticiens, à l’affût de toute nouveauté permettant de réactualiser les effets magiques par la mécanisation des performances. C’est par l’étude des techniques d’illusion propres à chaque média, dont les principes récurrents ont été mis au jour par les études intermédiales et l’archéologie des médias, que la rencontre avec l’art magique s’est imposée.

Ce colloque propose d’en analyser leur cycle technologique : le moment magique (croyance et émerveillement), le mode magique (rhétorique), la sécularisation (banalisation de la dimension magique). Ce cycle est analysé dans sa transversalité afin d’en souligner les dimensions intermédiales. Les communications sont ainsi regroupées en sept sections : L’art magique ; Magie et esthétiques de l’étonnement ; Magie, télévision et vidéo ; Les merveilles de la science ; Magie de l’image, l’image et la magie ; Magie du son, son et magie ; Du tableau vivant au mimétisme numérique. La première met en dialogue historiens et praticiens de la magie et présente un état des archives sur le sujet. Les six sections suivantes font état des corrélations: magie/médias et médias/magie.

Docteure ès Lettres, Mireille Berton est maître d’enseignement et de recherche à la Section d’Histoire et esthétique du cinéma de l'Université de Lausanne (UNIL).

Ses travaux portent principalement sur les rapports entre cinéma et sciences du psychisme (psychologie, psychanalyse, psychiatrie, parapsychologie), avec un intérêt particulier pour une approche croisant histoire culturelle, épistémologie des médias et Gender Studies.

Outre de nombreuses études, elle a publié un livre tiré de sa thèse de doctorat intitulé Le Corps nerveux des spectateurs. Cinéma et sciences du psychisme autour de 1900 (L’Âge d’Homme, 2015), et elle a co-dirigé avec Anne-Katrin Weber un ouvrage collectif consacré à l’histoire des dispositifs télévisuels saisie au travers de discours, pratiques, objets et représentations (La Télévision du Téléphonoscope à YouTube. Pour une archéologie de l'audiovision, Antipodes, 2009). Elle travaille actuellement sur un manuscrit consacré aux représentations du médium spirite dans les films et séries télévisées contemporains (à paraître chez Georg en 2017).

Résumé de la communication:

L'intervention propose de revenir sur une question souvent traitée dans l’histoire des sciences et de l’occultisme, à savoir le rôle joué par les instruments de mesure et de capture dans l’appréhension des faits paranormaux. Une analyse de sources spirites parues durant les premières décennies du XXe siècle permet de mettre au jour les tensions provoquées par les dispositifs optiques et électriques qui viennent défier le corps tout-puissant du médium spirite sur son propre territoire. La rencontre entre occultisme et modernité donne alors naissance à la figure (discursive et fantasmatique) du médium "hypermédiatique", celui-ci surpassant toutes les possibilités offertes par les découvertes scientifiques.

Related Links:

Friday, October 07. 2016

I&IC workshop #5 at ECAL: (esoteric) comments about the cloud (about the brief) | #cloud #technology #beliefs

Note: I mentioned last Tuesday an article I wrote last November (2015) on the blog of a research project (Inhabiting and Interfacing the Cloud(s)) that develop around the thematic of the "sublime" and its relation to contemporary technology.

In particular, in the frame of this research project, as a source of critical inspiration for a workshop we were preparing to lead with students at that time (critical because "magic" in the context of technology means what it means: tricked and not understanding, therefore believing or "stupefied").

For the matter of documentation, I reblog this post as well on | rblg as it brings different ideas about the "sublime" related to data or data centers, creation and contemporary technology in general.

It may be a bit hard to follow without the initial context (a brief by the invited guests, Random International and the general objectives of the project), but this context can be accessed from within the post -below-, for the ones interested to digg deeper.

...

As a matter of fact, this whole topic make me also think of the film The Prestige by Christopher Nolan. In which the figure of Nikola Tesla (played by "The Man Who Fell to Earth himself, a.k.a. David Bowie) is depicted as a character very close to a magician, his inventions with electricity being understood at the margin between sciences and magic.

Via IIClouds - Inhabiting and Interfacing the Cloud(s)

-----

Following the publication of Dev Joshi‘s brief on I&IC documentary blog yesterday (note: 10.11.2015), I took today the opportunity to briefly introduce it to the interaction design students that will be involved in the workshop next week. Especially, I focused on some points of the brief that were important but possibly quite new concepts for them. I also extended some implicit ideas with images that could obviously bring ideas about devices to build to access some past data, or “shadows” as Dev’s names them.

What comes out in a very interesting way for our research in Dev’s brief is the idea that the data footprints each of us leaves online on a daily basis (while using all type of digital services) could be considered as past entities of ourselves, or trapped, forgotten, hidden, … (online) fragments of our personalities… waiting to be contacted again.

How many different versions of you are there in the cloud? If they could speak, what would they say?

Yet, interestingly, if the term “digital footprint” is generally used in English to depict this situation (the data traces each of us leaves behind), we rather use in French the term “ombre numérique” (literally “digital shadow”). That’s why we’ve decided with Dev that it was preferable to use this term as the title for the workshop (The Everlasting Shadows): it is somehow a more vivid expression that could bring quite direct ideas when it comes to think about designing “devices” to “contact” these “digital entities” or make them visible again in some ways.

Philippe Ramette, “L’ombre de celui que j’étais / Shadow of my former self “, 2007. Light installation, mixed media.

By extension, we could also start to speak about “digital ghosts” as this expression is also commonly used (not to mention the “corps sans organes” of G. Deleuze/F. Gattari and previously A. Artaud). Many “ghosts”/facets of ourselves? All trapped online in the form of zombie data?

Your digital ghosts are trapped on islands around the cloud – is there a way to rescue them? Maybe they just need a shelter to live in now that you have moved on?

… or a haunted house?

And this again is a revealing parallel, because it opens the whole conceptual idea to beliefs… (about ghosts? about personal traces and shadows? about clouds? and finally, about technology? …)

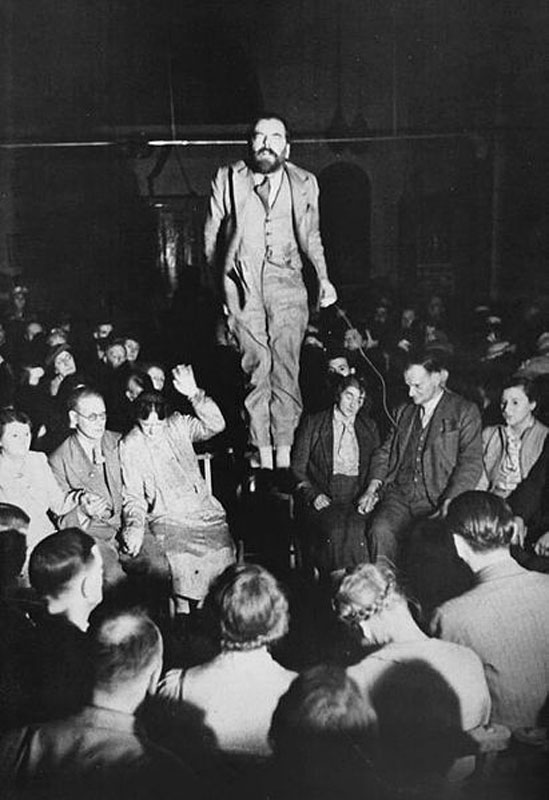

What about then to work with inspirations that would come from the spiritualism domain, its rich iconography and produce “devices” to communicate with your dead past data entities?

Fritz Lang. “Dr. Mabuse, the Gambler”, movie, 1922.

Or even start to think about some kind of “wearables”, and then become a new type of fraud technological data psychic?

Fraud medium Colin Evans in levitation, 13 June 1938 (source Wikipedia).

We could even digg deeper into these “beliefs” and start looking at old illustrations and engravings that depicts relations to “things that we don’t understand”, that are “beyond our understanding”… and that possibly show “tools” or strange machinery to observe or communicate with these “unknown things” (while trying to understand them)?

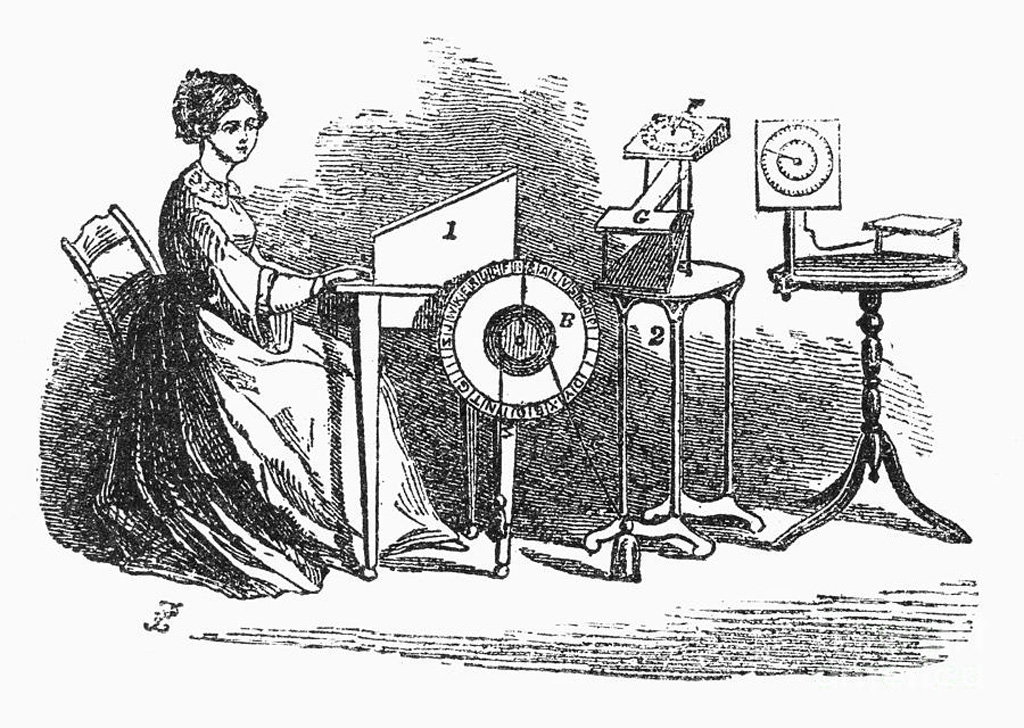

Spiritualism in 1855, author unknown.

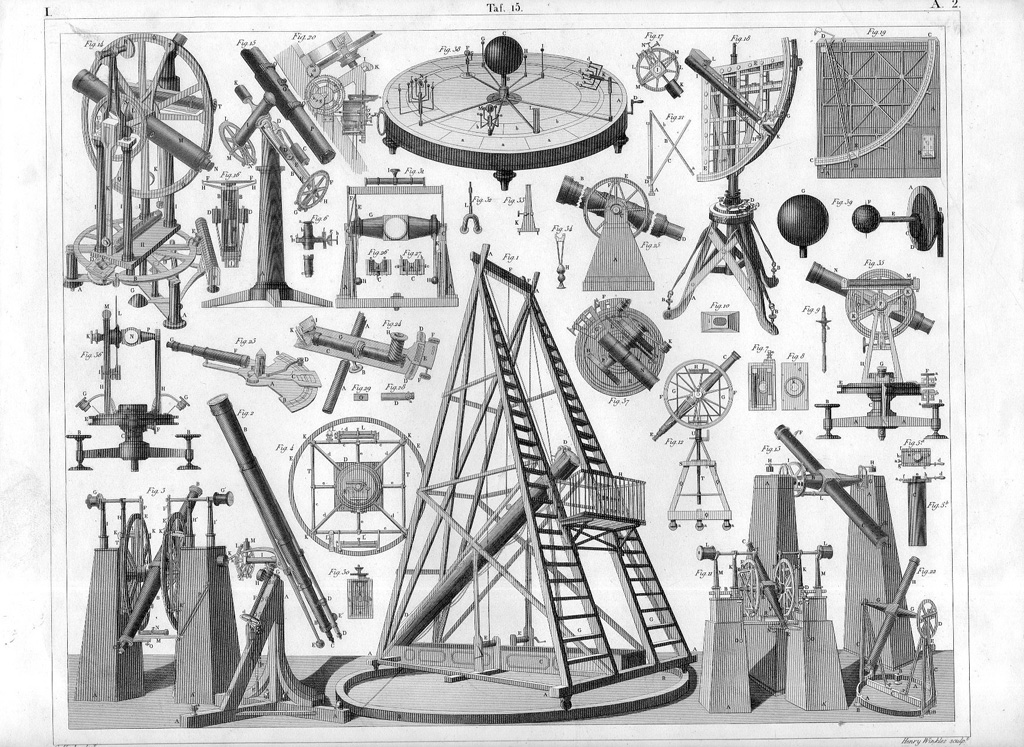

J.G. Heck. A plate from “The Iconographic Encyclopedia of Science, Literature and Art” published in 1851. Astronomy tools.

This last illustration could also drive us, by extension and a very straight shortcut , to the idea of the Sublime (in art, but also in philosophy), especially the romantic works of the painters from that period (late 18th and early 19th centuries, among them W. Turner, C. S. Friedrich, E. Delacroix, T. Cole, etc.)

Submerged by the presentiment of a nature that was in all dimensions dominating humans, that remained at that time mostly unexplained and mysterious, if not dangerous and feared, some painters took on this feeling, named “sublime” after Edmund Burke’s Philosophical Enquiry (1757), and start painting dramatic scenes of humans facing the forces of nature.

Thomas Cole, “The Voyage of Life: Old Age”, 1842. National Gallery of Art, Washington DC.

It is not by chance of course that I’ll end my “esoteric comments about the brief” post with this idea of the Sublime. This is because recently, the concept found a new life in regard to technology and its central yet “unexplained, mysterious, if not dangerous and feared” role in our contemporary society. The term got completed at this occasion to become the “Technological Sublime”, thus implicitly comparing the once dominant and “beyond our understanding” Nature to our contemporary technology.

“American Technological Sublime” by D. E. Nye, published in 1994 (MIT Press) was certainly one of the first book to join the two terms. It continues the exploration of the social construction of technology initiated in his previous book, “Electrifying America” (MIT Press, 1990). More recently in 2011, the idea popup again on the blog of Next Nature in an article simply entitled The Technological Sublime.

So, to complete my post with a last question, is the Cloud, that everybody uses but nobody seems to understand, a technologically sublime artifact? Wouldn’ it be ironic that an infrastructure, which aim is to be absolutely rational and functional, ultimately contributes to creates a completely opposite feeling?

Quotes are from Dev Joshi’s brief, “The Everlasting Shadow“.

Tuesday, October 04. 2016

LAnthropocène et lesthétique du sublime | #stupéfaction #bourgeoisie

Note: j'avais évoqué récemment cette idée du sublime dans le cadre d'un workshop à l'ECAL, avec pour invités Random International. Il s'agissait alors d'intervenir dans le cadre d'un projet de recherche où nous visions à développer des "contre-propositions" à l'expression actuelle de quelques-unes de nos infrastructures contemporaines, "douces" et "dures". Le "cloud computing" et les data-centers en particulier (le projet en question, en cours et dont le processus est documenté sur un blog: Inhabiting & Interfacing the Cloud(s)). Un projet conduit en collaboration avec Nicolas Nova de la HEAD - Genève

Tout cela s'était développé autour du sentiment d'une technologie, qui mettant aujourd'hui de nouveau "à distance" ses utilisateurs, contribuerait au développement de "croyances" (dimension "magique") et dans certains cas, à la résurgence du sentiment de "sublime", cette fois non plus lié aux puissances natutrelles "terrifiantes", mais aux technologies développées par l'homme. Je n'avais pas fait le lien avec cette thématique très actuelle de l'Anthropocène, que nous avions toutefois déjà commentée et pointée sur ce blog.

C'est fait dorénavant avec beaucoup de nuances par Jean-Baptiste Fressoz. Non sans souligner que "(...) cette opération esthétique, au demeurant très réussie, n’est pas sans poser problème car ce qui est rendu sublime ce n’est évidemment pas l’humanité, mais c’est, de fait, le capitalisme".

...

On peut aussi se souvenir qu'en 1990 déjà, Michel Serres écrivait dans son livre Le Contrat Naturel:

"Voici maintenant formée la contemporaine société, qu'on peut appeler deux fois mondiale: occupant toute la terre, solidaire comme un bloc, par ses interrelations croisées, elle ne dispose d'aucun reste, de recul ni de recours, ou planter sa tente et dans quel extérieur. Elle sait, d'autre part, construire et utiliser des moyens techniques aux dimensions spatiales, temporelles, énergétiques des phénomènes du monde. Notre puissance collective atteint donc les limites de notre habitat global. Nous commençons à ressembler à la Terre."

Texte que nous avions par ailleurs cité avec fabric | ch dans l'un de nos premiers projets, Réalité Recombinée, en 1998.

Via Mouvements (via Nicolas Nova)

-----

Par Jean-Baptiste Fressoz

Olafur Eliasson à la Tate Modern.

Pour Jean-Baptiste Fressoz, la force de l’idée d’Anthropocène n’est pas conceptuelle, scientifique ou heuristique : elle est avant tout esthétique. Dans cet article, l’auteur revient, pour en pointer les limites, sur les ressorts réactivés de cette esthétique occidentale et bourgeoise par excellence [note: le sublime], vilipendée par différents courants critiques. Il souligne qu’avant d’embrasser complètement l’Anthropocène, il faut bien se rappeler que le sublime n’est qu’une des catégories de l’esthétique, qui en comprend d’autres (le tragique, le beau…) reposant sur d’autres sentiments (l’harmonie, la douleur, l’amour…), peut-être plus à même de nourrir une esthétique du soin, du petit, du local dont l’agir écologique a tellement besoin.

Aussi sidérant, spectaculaire ou grandiloquent qu’il soit, le concept d’Anthropocène ne désigne pas une découverte scientifique [1]. Il ne représente pas une avancée majeure ou récente des sciences du système-terre. Nom attribué à une nouvelle époque géologique à l’initiative du chimiste Paul Crutzen, l’Anthropocène est une simple proposition stratigraphique encore en débat parmi la communauté des géologues. Faisant suite à l’Holocène (12 000 ans depuis la dernière glaciation), l’Anthropocène est marquée par la prédominance de l’être humain sur le système-terre. Plusieurs dates de départ et marqueurs stratigraphiques afférents sont actuellement débattus : 1610 (point bas du niveau de CO2 dans l’atmosphère causé par la disparition de 90% de la population amérindienne), 1830 (le niveau de CO2 sort de la fourchette de variabilité holocénique), 1945 date de la première explosion de la bombe atomique.

La force de l’idée d’Anthropocène n’est pas conceptuelle, scientifique ou heuristique : elle est avant tout esthétique. Le concept d’Anthropocène est une manière brillante de renommer certains acquis des sciences du système-terre. Il souligne que les processus géochimiques que l’humanité a enclenchés ont une inertie telle que la terre est en train de quitter l’équilibre climatique qui a eu cours durant l’Holocène. L’Anthropocène désigne un point de non retour. Une bifurcation géologique dans l’histoire de la planète Terre. Si nous ne savons pas exactement ce que l’Anthropocène nous réserve (les simulations du système-terre sont incertaines), nous ne pouvons plus douter que quelque chose d’importance à l’échelle des temps géologiques a eu lieu récemment sur Terre.

Le concept d’Anthropocène a cela d’intéressant, mais aussi de très problématique pour l’écologie politique, qu’il réactive les ressorts de l’esthétique du sublime, esthétique occidentale et bourgeoise par excellence, vilipendée par les critiques marxistes, féministes et subalternistes, comme par les postmodernes. Le discours de l’Anthropocène correspond en effet assez fidèlement aux canons du sublime tels que définis par Edmund Burke en 1757. Selon ce philosophe anglais conservateur, surtout connu pour son rejet absolu de 1789, l’expérience du sublime est associée aux sensations de stupéfaction et de terreur ; le sublime repose sur le sentiment de notre propre insignifiance face à une nature lointaine, vaste, manifestant soudainement son omnipuissance. Écoutons maintenant les scientifiques promoteurs de l’Anthropocène :

« L’humanité, notre propre espèce, est devenue si grande et si active qu’elle rivalise avec quelques-unes des grandes forces de la Nature dans son impact sur le fonctionnement du système terre […]. Le genre humain est devenu une force géologique globale [2] ».

La thèse de l’Anthropocène repose en premier lieu sur les quantités phénoménales de matière mobilisées et émises par l’humanité au cours des XIXe et XXe siècles. L’esthétique de la gigatonne de CO2 et de la croissance exponentielle renvoie à ce que Burke avait noté : « la grandeur de dimension est une puissante cause du sublime [3] », et, ajoute-t-il, le sublime demande « le solide et les masses mêmes [4] ». De manière plus précise, l’Anthropocène reporte le sublime de la vaste nature vers « l’espèce humaine ». Tout en jouant du sublime, il en renverse les polarités classiques : la terreur sacrée de la nature est transférée à une humanité colosse géologique.

Or, cette opération esthétique, au demeurant très réussie, n’est pas sans poser problème car ce qui est rendu sublime ce n’est évidemment pas l’humanité, mais c’est, de fait, le capitalisme. L’Anthropocène n’est certainement pas l’affaire d’une « espèce humaine », d’un « anthropos » indifférencié, ce n’est même pas une affaire de démographie : entre 1800 et 2000 la population humaine a été multipliée par sept, la consommation d’énergie par 50 et le capital, si on reprend les chiffres de Thomas Picketty, par 134 [5]. Ce qui a fait basculer la planète dans l’Anthropocène, c’est avant tout une vaste technostructure orientée vers le profit, une « seconde nature », faite de routes, de plantations, de chemins de fer, de mines, de pipelines, de forages, de centrales électriques, de marchés à terme, de porte-containers, de places financières et de banques et bien d’autres choses encore qui structurent les flux de matière et d’énergie à l’échelle du globe selon une logique structurellement inégalitaire. Bref, le changement de régime géologique est bien sûr le fait de « l’âge du capital [6] » bien plus que le fait de « l’âge de l’être humain » dont nous rebattent les récits dominants [7]. Le premier problème du sublime de l’Anthropocène est qu’il renomme, esthétise et surtout naturalise le capitalisme, dont la force se mesure dorénavant à l’aune des manifestations de la première nature – les volcans, la tectonique des plaques ou les variations des orbites planétaires – que deux siècles d’esthétique du sublime nous avaient appris à craindre mais aussi à révérer.

Au sublime de la quantité, l’Anthropocène ajoute le sublime géologique des âges et des éons, duquel il tire ses effets les plus saisissants. La thèse de l’Anthropocène nous dit en substance que les traces de notre âge industriel resteront pour des millions d’années dans les archives géologiques de la planète. Le fait d’ouvrir une nouvelle époque taillée à la mesure de l’être humain signifie que c’est à l’échelle des temps géologiques seulement que l’on peut identifier des événements agissant avec autant de force sur la planète que nous-mêmes : le taux de dioxyde de carbone en 2015 est sans précédent depuis trois millions d’années, le taux actuel d’extinction des espèces, depuis 65 millions d’années, l’acidité des océans, depuis 300 millions d’années, etc. Ce que nous vivons n’est pas une simple « crise environnementale », mais une révolution géologique d’origine humaine. Loin de constituer un cours extérieur, impavide et gigantesque, le temps de la Terre est devenu commensurable au temps de l’agir humain. En deux siècles tout au plus, l’humanité a altéré la dynamique du système-terre pour l’éternité ou presque. « Tout ce qui fait transition n’excite aucune terreur [8] » écrivait Burke. Le discours de l’Anthropocène cultive cette esthétique de la soudaineté, de la bifurcation et de l’événement. Le sublime de l’Anthropocène réside précisément dans cette rencontre extraordinaire : deux siècles d’activité humaine, une durée infime, quasi-nulle au regard de l’histoire terrienne, auront suffi à provoquer une altération comparable au grand bouleversement de la fin du Mésozoïque il y a 65 millions d’années.

La troisième source du sublime anthropocénique est le sublime de la violence souveraine de la nature, celle des tremblements de terre, des tempêtes et des ouragans. Les promoteur·rice·s de l’Anthropocène mobilisent volontiers le sublime romantique des ruines, des civilisations disparues et des effondrements : « Les moteurs de l’Anthropocène pourraient bien menacer la viabilité de la civilisation contemporaine et peut-être même l’existence d’homo sapiens [9] ». Le succès artistique et médiatique du concept repose sur la « jouissance douloureuse », sur le « plaisir négatif » dont parle Burke :

« Nous jouissons à voir des choses que, bien loin de les occasionner, nous voudrions sincèrement empêcher… Je ne pense pas qu’il existe un·e ho·femme assez scélérat·e· pour désirer [que Londres] fût renversée par un tremblement de terre… Mais supposons ce funeste accident arrivé, quelle foule accourrait de toute part pour contempler ses ruines [10] ».

William Kentridge

L’Anthropocène s’appuie sur une culture de l’effondrement propre aux nations occidentales, qui, depuis deux siècles, admirent leur puissance en fantasmant les ruines de leur futur. L’Anthropocène joue des mêmes ressorts psychologiques que le plaisir pervers des décombres déjà décrit par Burke et qui nourrit la vogue actuelle du tourisme des catastrophes de Tchernobyl à ground zero.

La violence de l’Anthropocène est aussi celle de la science hautaine et froide qui nomme les époques et définit notre condition historique. Violence, tout d’abord, de son diagnostic irrévocable : « toi qui entre dans l’Anthropocène abandonne tout espoir » semblent nous dire les savant·e·s. Violence ensuite de la naturalisation, de la « mise en espèce » des sociétés humaines : les statistiques globales de consommation et d’émissions compactent les mille manières d’habiter la terre en quelques courbes, effaçant par la même l’immense variation des responsabilités entre les peuples et les classes sociales. Violence enfin du regard géologique tourné vers nous-mêmes, jaugeant toute l’histoire (empires, guerres, techniques, hégémonies, génocides, luttes, etc.) à l’aune des traces sédimentaires laissées dans la roche. Le géologue de l’Anthropocène est plus effroyable encore que l’ange de l’histoire de Walter Benjamin qui, là même où nous voyions auparavant progrès, ne voyait que catastrophe et désastre : lui n’y voit que fossiles et sédiments.

Que le sublime soit l’esthétique cardinale de l’Anthropocène n’est absolument pas fortuit : sublime et géologie se sont épaulés tout au long de leur histoire. En 1674, Nicolas Boileau traduit en français le traité de Longinus sur le sublime (1er siècle après J.-C.) introduisant ainsi cette notion dans l’Europe lettrée. Mais c’est seulement au milieu du XVIIIe siècle, après que la passion des montagnes et l’intérêt pour la géologie se sont cristallisés dans les classes supérieures, que la « grande nature » devient un objet de sublime [11]. Partis pour leur « grand tour », sur le chemin de l’Italie, les jeunes Anglais·es fortuné·e·s rencontrent en effet la chaîne des Alpes, ses pics vertigineux, ses glaciers terrifiants et ses panoramas immenses. Dans les récits de grands tours, l’expérience de l’effroi face à la nature représente le prix à payer pour goûter la beauté des trésors culturels de l’Italie. Le sublime joue ici un rôle de distinction : être capable de prendre du plaisir en contemplant les glaciers, ou les rochers arides, permettait aux touristes anglais·es de se différencier des guides et des paysan·e·s montagnard·e·s qui n’y voyaient que dangers et terres incultes. Mais c’est évidemment le tremblement de terre de Lisbonne de 1755 qui fournit le véritable coup d’envoi des réflexions sur le sublime : Burke, qui publie son traité l’année suivante, fait référence à la passion esthétique des décombres et des ruines qui saisit alors l’Europe entière. La même année, Emmanuel Kant publie également un court ouvrage sur le tremblement de terre de Lisbonne et, dans son essai ultérieur sur le sublime, il définit ce dernier comme un « plaisir négatif » pouvant procéder de deux manières : le sublime mathématique ressenti devant l’immensité de la nature (l’espace étoilé, l’océan etc.) et le « sublime dynamique » procuré par la violence de la nature (tornade, volcan, tremblement de terre).

Le sublime de l’Anthropocène, et sa mise en scène d’une humanité devenue force tellurique signe la rencontre historique du sublime naturel du XVIIIe siècle et du sublime technologique des XIXe et XXe siècles. Avec l’industrialisation de l’Occident, la puissance de la seconde nature fait l’objet d’une intense célébration esthétique. Le sublime transféré à la technique jouait un rôle central dans la diffusion de la religion du progrès : les gares, les usines et les gratte-ciels en constituaient les harangues permanentes [12]. Dès cette époque, l’idée d’un monde traversé par la technique, d’une fusion entre première et seconde natures fait l’objet de réflexions et de louanges. On s’émerveille des ouvrages d’art matérialisant l’union majestueuse des sublimes naturel et humain : viaducs enjambant les vallées, tunnels traversant les montagnes, canaux reliant les océans, etc. L’idée d’un globe remodelé pour les besoins de l’être humain et fertilisé par la technique constitue une trope classique du positivisme depuis Saint-Simon au moins, qui, dès 1820, écrivait :

« l’objet de l’industrie est l’exploitation du globe, c’est-à-dire l’appropriation de ses produits aux besoins de l’homme, et comme, en accomplissant cette tâche, elle modifie le globe, le transforme, change graduellement les conditions de son existence, il en résulte que par elle, l’homme participe, en dehors de lui-même en quelque sorte, aux manifestations successives de la divinité, et continue ainsi l’œuvre de la création. De ce point de vue, l’Industrie devient le culte [13] ».

De manière plus précise, l’Anthropocène s’inscrit dans une version du sublime technologique reconfigurée par la guerre froide. Il prolonge la vision spatiale de la planète produite par le système militaro-industriel américain, une vision déterrestrée de la Terre saisie depuis l’espace comme un système que l’on pourrait comprendre dans son entièreté, un « spaceship earth » dont on pourrait maîtriser la trajectoire grâce aux nouveaux savoirs sur le système-terre [14]. Le risque est que l’esthétique de l’Anthropocène nourrisse davantage l’hubris d’une géo-ingénierie brutale qu’un travail patient, à la fois modeste et ambitieux d’involution et d’adaptation du social. Pour mémoire, la géo-ingénierie désigne un ensemble de techniques visant à modifier artificiellement le pouvoir réfléchissant de l’atmosphère terrestre pour contrecarrer le réchauffement climatique. Cela peut constituer par exemple à injecter du dioxyde de soufre dans la haute atmosphère afin de réfléchir une partie du rayonnement solaire vers l’espace. L’échec des gouvernements à obtenir un accord international contraignant et ambitieux a contribué à mettre en avant la géo-ingénierie, en tant que « plan B ». Ces techniques potentiellement très risquées pourraient donc soudainement s’imposer en cas « d’urgence climatique ».

Pour ses promoteur·rice·s, l’Anthropocène est une révélation, un éveil, un changement de paradigme désorientant soudainement les représentations vulgaires du monde.

« Par le passé, du fait de la science, l’humanité a dû faire face à de profondes remises en cause de leurs systèmes de croyance. Un des exemples les plus important est la théorie de l’évolution… Le concept d’anthropocène pourrait susciter une réaction hostile similaire à celle que Darwin a produite [15] ».

On retrouve ici le trope romantique du·de la savant·e· payant de sa personne pour lutter contre la foule hostile. En se coupant ainsi du passé et de la décence environnementale commune, en rejetant comme dépassés les savoirs environnementaux qui le précèdent ainsi que les luttes sociales que ces savoirs ont nourries, l’Anthropocène dépolitise l’histoire longue de la destruction de la planète. Avant on ignorait les conséquences globales de l’agir humain, maintenant l’on sait, et, bien entendu, maintenant l’on peut agir. La prétention à la nouveauté des savoirs sur la Terre est aussi une prétention des savants à agir sur celle-ci. Ce n’est pas un hasard si l’inventeur du mot Anthropocène, le prix Nobel de chimie Paul Crutzen, est aussi l’un des avocat·e·s des techniques de géo-ingénierie. À l’Anthropocène inconscient issu de la révolution industrielle succéderait enfin le « bon Anthropocène » éclairé par les savoirs du système-terre. Comme toute forme de scientisme, l’esthétique de l’Anthropocène anesthésie le politique : les « expert·e·s », les autorités vont « faire quelque chose ».

Les expériences du sublime sont toujours à replacer dans un contexte historique et politique particulier. Elles renvoient à des émotions dépendantes des conditions culturelles, naturelles ou technologiques de chaque époque et ce sont ces conditions qui en fournissent les clés de compréhension politique. De la fin du XVIIIe siècle à la fin du siècle suivant, le sublime d’une nature violente et abstraite permettait aux classes bourgeoises urbaines de goûter à la violence de la nature, tout en étant relativement protégées de ses manifestations et de relativiser les dangers bien réels d’un mode de vie technologique et urbain. L’art du sublime nourrissait également le fantasme d’une nature immense et inépuisable au moment précis où l’impérialisme en exploitait les derniers recoins. Dans une culture prenant au sérieux le projet de maîtrise technique de la nature, l’esthétique du sublime fournissait aussi un plaisir légèrement coupable. Enfin, selon le critique marxiste Terry Eagleton, le sublime correspondait aux impératifs esthétiques du capitalisme naissant : contre l’esthétique émolliente du beau, risquant de transformer le sujet bourgeois en sensualiste décadent, le sublime réénergisait le sujet capitaliste comme exploiteur·se ou comme pourvoyeur de travail. Le beau devient à la fin du XVIIIe siècle l’harmonieux, le non-productif, le doux et le féminin ; le sublime : l’effort, le danger, la souffrance, l’élevé, le majestueux et le masculin. Au fond, le sublime, nous dit Eagleton, contenait la menace que la beauté faisait peser sur la productivité [16].

Au début des années 2000, le sublime de l’Anthropocène occupe également une fonction idéologique. Alors que les classes intellectuelles se convertissent au souci écologique, alors qu’elles rejettent les idéaux modernistes de maîtrise de la nature comme has been, alors qu’elles proclament « la fin des grands récits », la fin du progrès, de la lutte des classes, etc., l’Anthropocène procure le frisson coupable d’un nouveau récit sublime. Sur un fond d’agnosticisme quant au futur, l’Anthropocène paraît donner un nouvel horizon grandiose à l’humanité tout entière : prendre en charge collectivement le destin d’une planète. Dans le contexte idéologique terne de l’écologie politique, du développement durable et de la précaution, penser le mouvement d’une humanité devenue force tellurique paraît autrement plus excitant que penser l’involution d’un système économique. Au fond le sublime de l’Anthropocène rejoue assez exactement la scène finale du chef-d’œuvre de Stanley Kubrick, 2001 l’Odyssée de l’espace : l’embryon stellaire contemplant la terre figurant parfaitement l’avènement d’un agent géologique conscient, d’un corps planétaire réflexif. Et c’est bien pour cela que l’Anthropocène fait tressaillir théoricien·ne·s, philosophes et artistes en herbe : il semble désigner un événement métaphysique intéressant.

Pour l’écologie politique contemporaine, l’esthétique sublime de l’Anthropocène pose pourtant problème : en mettant en scène l’hybridation entre première et seconde natures, elle réénergise l’agir technologique des cold warriors (la géo-ingénierie) ; en déconnectant l’échelle individuelle et locale de ce qui importe vraiment (l’humanité force tellurique et les temps géologiques), elle produit sidération et cynisme (no future) ; enfin l’Anthropocène, comme tout autre sublime, est sujet à la loi des rendements décroissants : une fois que l’audience est préparée et conditionnée, son effet s’émousse. En ce sens, désigner une œuvre d’art comme « art de l’Anthropocène » serait absolument fatale à son efficacité esthétique. Le risque est que l’écologie du sublime soit alors appelée à une surenchère permanente, semblable en cela à la course à l’avant-garde dans l’art contemporain. Avant d’embrasser complètement l’Anthropocène, il faut bien se rappeler que le sublime n’est qu’une des catégories de l’esthétique, qui en comprend bien d’autres (le tragique, le beau, le pittoresque…) reposant sur d’autres sentiments (l’harmonie, l’ataraxie, la tristesse, la douleur, l’amour), qui sont peut-être plus à même de nourrir une esthétique du soin, du petit, du local, du contrôle, de l’ancien et de l’involution dont l’agir écologique a tellement besoin.

[1] Cet article reprend sous une forme modifiée un texte déjà paru dans le catalogue de l’exposition Sublime. Les tremblements du monde, Centre Pompidou-Metz, Metz, Centre Pompidou-Metz, 2016.

[2] W. Steffen, J. Grinevald, P. Crutzen, J. McNeill, « The Anthropocene : conceptual and historical perspectives », Philosophical transactions of the Royal Society A, 369, 2011, p. 842–867.

[3] E. Burke, Recherche philosophique sur l’origine de nos idées du sublime et du beau, Paris, Pichon, 1803 (1757), p. 129.

[4] Ibid., p. 225.

[5] T. Piketty, Le capital au XXIe siècle, Paris, Seuil, 2013.

[6] E. Hobsbawm, The Age of Capital : 1848-1975, London, Weindefeld, 1975.

[7] Voir le chapitre « capitalocène » de la nouvelle édition de C. Bonneuil, J.-B. Fressoz, L’événement Anthropocène. La terre, l’histoire et nous, Paris, Seuil, 2016.

[8] E. Burke, op. cit. p. 151.

[9] W. Steffen et al., art. cit.

[10] E. Burke, op. cit., p. 85.

[11] M. Hope Nicholson, Mountain gloom and mountain glory: The development of the aesthetics of the infinite, Ithaca, Cornell University Press, 1959.

[12] D. Nye, American technological sublime, Cambridge (MA), MIT Press, 1994.

[13] Saint-Simon, Doctrine de Saint-Simon, t. 2, Paris, Aux Bureaux de l’Organisateur, 1830, p. 219.

[14] C. Bonneuil, J.-B. Fressoz, op. cit. ; S. Grevsmühl, La Terre vue d’en haut. L’invention de l’environnement global, Paris, Seuil, 2014.

[15] W. Steffen et al., art. cit.

[16] Terry Eagleton, The Ideology of the Aesthetic, Oxford, Basil Blackwell, 1990.

Related Links:

Wednesday, September 21. 2016

This is your brain on LSD | #perception #psychedelism

Via c|net (via @chrstphggnrd)

-----

For the first time, a team of researchers have used neuroimaging to visualise the effect of LSD on the human brain.

A lot of research has been conducted into how psychedelic drug lysergic acid diethylamide, or LSD, affects human behaviour, but what does it actually do to the brain? To find out, a team of researchers from Imperial College London gave some test subjects the drug, and documented the results using brain imaging techniques.

This is the first time the human brain has been imaged while under the influence of LSD. The research has been published in the Proceedings of the National Academy of Sciences.

Harry L Williams administers LSD 25 to Carl Pfeiffer, chairman of Emory University's Pharmacological Department, in 1955. The experiment was documented using the microphone. Bettmann/Corbis.

LSD is known for its hallucinogenic properties and altered consciousness, and the results of the study revealed why.

"We observed brain changes under LSD that suggested our volunteers were 'seeing with their eyes shut' -- albeit they were seeing things from their imagination rather than from the outside world," explained study leader Robin Carhart-Harris in a statement.

"We saw that many more areas of the brain than normal were contributing to visual processing under LSD -- even though the volunteers' eyes were closed. Furthermore, the size of this effect correlated with volunteers' ratings of complex, dreamlike visions."

The top row shows the brains of the study participants on the placebo, the bottom row shows the study participants on LSD. Imperial College London.

The study involved 20 healthy participants, each of whom had previously taken some form of psychedelic drug. Each participant received either 75 micrograms of LSD or a placebo, and their brains were then imaged.

The results revealed that the barriers between the sections of the brain that perform specialised functions break down under the influence of LSD. This means that, as mentioned, more of the brain is involved in visual processing, which causes the hallucinations, but it also contributes to the altered consciousness associated with LSD.

"It is also related to what people sometimes call 'ego-dissolution', which means the normal sense of self is broken down and replaced by a sense of reconnection with themselves, others and the natural world. This experience is sometimes framed in a religious or spiritual way -- and seems to be associated with improvements in well-being after the drug's effects have subsided," Carhart-Harris said.

"Our brains become more constrained and compartmentalised as we develop from infancy into adulthood, and we may become more focused and rigid in our thinking as we mature. In many ways, the brain in the LSD state resembles the state our brains were in when we were infants: free and unconstrained. This also makes sense when we consider the hyper-emotional and imaginative nature of an infant's mind."

Adding music to the mix caused even more interesting changes in brain activity, causing the visual cortex to receive more information from the region of the brain associated with mental imagery and personal memory. Under the influence of both music and LSD, the study participants reported seeing even more complex visions, such as memories played out as scenes.

"Scientists have waited 50 years for this moment -- the revealing of how LSD alters our brain biology," said senior researcher David Nutt , Edmon J Safra Chair in Neuropsychopharmacology.

"For the first time we can really see what's happening in the brain during the psychedelic state, and can better understand why LSD had such a profound impact on self-awareness in users and on music and art. This could have great implications for psychiatry, and helping patients overcome conditions such as depression."

Tuesday, September 13. 2016

Illusions ... | #andscience

Note: what about starting again after the Summer #farniente with some "illusions and science"? "Amazing" that's for sure.

Would have certainly been a useful resource for the research workshop we led around "the cloud" with Random International, about ghost data presence (and to develop Ghost Data Interfaces). Especially as I pointed out the "sublime" dimension of technology in a related post.

-----

Via brusspup (channel on Youtube)

...

with some gyroscopes:

(remember that btw?)

...

or with some magnets:

...

or even with some hammer!

...

and many more tricks on Brussup channel, mainly in its "Cool science Tricks" playlist.

Monday, June 13. 2016

Wolfram Data Drop vs. Datadroppers | #data #drop #pick #compute

Note: after a few weeks posting about the Universal Income, here comes the "Universal data accumulator for devices, sensors, programs, humans & more" by Wolfram (best known for Wolfram Alpha computational engine and the former Mathematica libraries, on which most of their other services seem to be built).

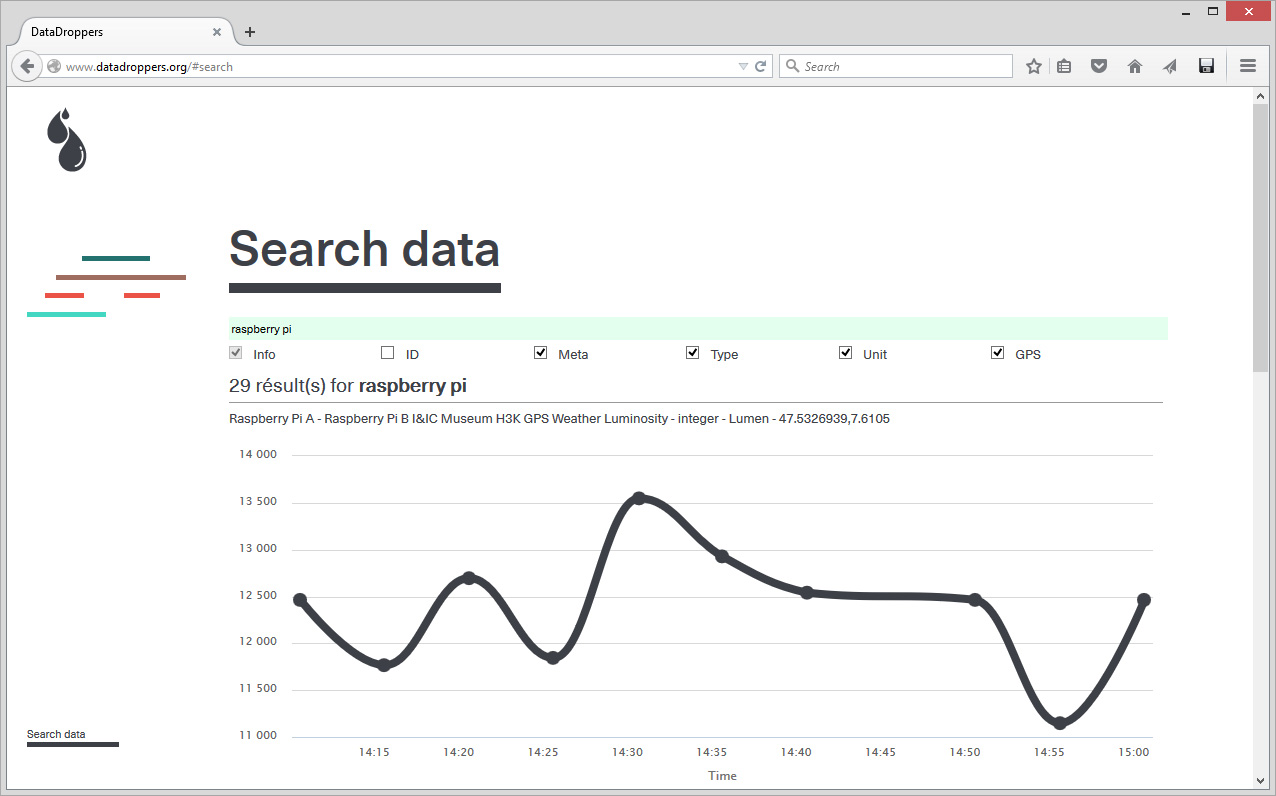

Funilly, we've picked a very similar name for a very similar data service we've set up for ourselves and our friends last year, during an exhibition at H3K: Datadroppers (!), with a different set of references in our mind (Drop City? --from which we borrowed the colors-- "Turn on, tune in, drop out"?) Even if our service is logically much more grassroots, less developed but therfore quite light to use as well.

We developed this project around data dropping/picking with another architectural project in mind that I'll speak about in the coming days: Public Platform of Future-Past. It was clearly and closely linked.

"Universal" is back in the loop as a keyword therefore... (I would rather adopt a different word for myself and the work we are doing though: "Diversal" --which is a word I'm using for 2 yearnow and naively thought I "invented", but not...)

Via Wolfram

-----

"The Wolfram Data Drop is an open service that makes it easy to accumulate data of any kind, from anywhere—setting it up for immediate computation, visualization, analysis, querying, or other operations." - which looks more oriented towards data analysis than use in third party designs and projects.

Via Datadroppers

-----

"Datadroppers is a public and open data commune, it is a tool dedicated to data collection and sharing that tries to remain as simple, minimal and easy to use as possible." Direct and light data tool for designers, belonging to designers (fabric | ch) that use it for their own projects...

Tuesday, June 07. 2016

Unconditional Basic Income, first national vote | #unconditional #income #automation

Note: I've posted several articles about automation recently. This was the occasion to continue collect some thoughts about the topic (automation then) so as the larger social implications that this might trigger.

But it was also a "collection" that took place at a special moment in Switzerland when we had to vote about the "Revenu the Base Inconditionnel" (Unconditional Basic Income). I mentioned it in a previous post ("On Algorithmic Communism"), in particular the relation that is often made between this idea (Basic Income / Universal Income) and the probable evolution of work in the decades to come (less work for "humans" vs. more for "robots").

Well, the campain and votation triggered very interesting debates among the civil population, but in the end and predictably, the idea was largely rejected (~25% of the voters accepted it, with some small geographical areas that indeed acceted it at more than 50% --urban areas mainly--. Some where not so far, for exemple the city capital, Bern, voted at 40% for the RBI).

This was very new and a probably too (?) early question for the Swiss population, but it will undoubtedly become a growing debate in the decades to come. A question that has many important associated stakes.

-----

Press talking about the RBI, image from RTS website.

More about it (in French) on the website of the swiss television.

Friday, May 27. 2016

What to Do When a Robot Is the Guilty Party | #ai #law #society #smart?

Note: "(...) For example, technologists might be held responsible if they use poor quality data to train AI systems, or fossilize prejudices based on race, age, or gender into the algorithms they design."

Mind your data and the ones you'll use to "fossilize", so to say (and as long as you'll already know what's in your data)... It is then no more about "if" you're collecting data, but "which" data you'll use to feed your AIs, and "how". Now that we clearly see that large corporations plan to use more and more of these kind of techs to also drive "domestic" applications (and by extension as we already know "personal" applications of all sorts), it will be important to understand the stakes behind them as it will become part of our social and design context.

An important problem that I can see for designers and architects is that if you don't agree with the principles --commercial, social, ethical and almost conceptual-- implied by the technologies (i.e. any "homekit" like platforms controlled by bots), you won't find many if any counter propositions/techs to work with (all large diffusion products will support iOS, Android and the likes). It is almost a dictatorship of products hidden behind a "participate" paradigma. Either you'll be in and accept the conditions (you might use an API provided with the service --FB, Twitter, IFTTT, Apple, Google, Wolfram, Siemens, MS, etc.--, but then feed the central company nonetheless), or out... or possibly develop you own solution(s) that will probably be a pain in the ass to use for your client because it/they will clearly be side products hard to maintain, update, etc.

"Some" open source projects driven by "some" communities could be/become (should be) alternative solutions of course, but for now these are good for prototyping and teaching, not for consistent "domestic" applications... And when they'll possibly do so, they might likely be bought. So we'll have "difficulties" as (interaction) designers, so to say: you'll work for your client(s) ... and the corp. that provides the services you'll use!

----

The Obama administration is vowing not to get left behind in the rush to artificial intelligence, but determining how to regulate it isn’t easy.

By Mark Harris

Should the government regulate artificial intelligence? That was the central question of the first White House workshop on the legal and governance implications of AI, held in Seattle on Tuesday.

“We are observing issues around AI and machine learning popping up all over the government,” said Ed Felten, White House deputy chief technology officer. “We are nowhere near the point of broadly regulating AI … but the challenge is how to ensure AI remains safe, controllable, and predictable as it gets smarter.”

One of the key aims of the workshop, said one of its organizers, University of Washington law professor Ryan Calo, was to help the public understand where the technology is now and where it’s headed. “The idea is not for the government to step in and regulate AI but rather to use its many other levers, like coördination among the agencies and procurement power,” he said. Attendees included technology entrepreneurs, academics, and members of the public.

In a keynote speech, Oren Etzioni, CEO of the Allen Institute for Artificial Intelligence, noted that we are still in the Dark Ages of machine learning, with AI systems that generally only work well on well-structured problems like board games and highway driving. He championed a collaborative approach where AI can help humans to become safer and more efficient. “Hospital errors are the third-leading cause of death in the U.S.,” he said. “AI can help here. Every year, people are dying because we’re not using AI properly in hospitals.”

Oren Etzioni, CEO of the Allen Institute for Artificial Intelligence, left, speaks with attendees at the White House workshop on artificial intelligence.

Nevertheless, Etzioni considers it far too early to talk about regulating AI: “Deep learning is still 99 percent human work and human ingenuity. ‘My robot did it’ is not an excuse. We have to take responsibility for what our robots, AI, and algorithms do.”

A panel on “artificial wisdom” focused on when these human-AI interactions go wrong, such as the case of an algorithm designed to predict future criminal offenders that appears to be racially biased. “The problem is not about the AI agents themselves, it’s about humans using technological tools to oppress other humans in finance, criminal justice, and education,” said Jack Balkin of Yale Law School.

Several academics supported the idea of an “information fiduciary”: giving people who collect big data and use AI the legal duties of good faith and trustworthiness. For example, technologists might be held responsible if they use poor quality data to train AI systems, or fossilize prejudices based on race, age, or gender into the algorithms they design.

As government institutions increasingly rely on AI systems for decision making, those institutions will need personnel who understand the limitations and biases inherent in data and AI technology, noted Kate Crawford, a social scientist at Microsoft Research. She suggested that students be taught ethics alongside programming skills.

Bryant Walker Smith from the University of South Carolina proposed regulatory flexibility for rapidly evolving technologies, such as driverless cars. “Individual companies should make a public case for the safety of their autonomous vehicles,” he said. “They should establish measures and then monitor them over the lifetime of their systems. We need a diversity of approaches to inform public debate.”

This was the first of four workshops planned for the coming months. Two will address AI for social good and issues around safety and control, while the last will dig deeper into the technology’s social and economic implications. Felten also announced that the White House would shortly issue a request for information to give the general public an opportunity to weigh in on the future of AI.

The elephant in the room, of course, was November’s presidential election. In a blog post earlier this month, Felten unveiled a new National Science and Technology Council Subcommittee on Machine Learning and Artificial Intelligence, focused on using AI to improve government services “between now and the end of the Administration.”

Related Links:

Tuesday, May 24. 2016

Building AI is hard So Facebook is building AI that builds AI | #automation #ai

Note: even people developing automation will be automated, so to say...

Do you want to change this existing (and predictable) future? This would be the right time to come with counter-proposals then...

But I'm quite surprized by the absence of nuanced analysis in the Wired article btw (am I? further than "make the workd a better place" I mean): indeed, this is a scientific achievement, but then what? no stakes? no social issues? It seems to be the way things should go then... (and some people know pretty well how "The Way Things Go", always wrong ;)), to the point that " No, Asimo isn’t quite as advanced—or as frightening—as Skynet." Good to know!

Via Wired

-----

By Cade Metz

Deep neural networks are remaking the Internet. Able to learn very human tasks by analyzing vast amounts of digital data, these artificially intelligent systems are injecting online services with a power that just wasn’t viable in years past. They’re identifying faces in photos and recognizing commands spoken into smartphones and translating conversations from one language to another. They’re even helping Google choose its search results. All this we know. But what’s less discussed is how the giants of the Internet go about building these rather remarkable engines of AI.

Part of it is that companies like Google and Facebook pay top dollar for some really smart people. Only a few hundred souls on Earth have the talent and the training needed to really push the state-of-the-art forward, and paying for these top minds is a lot like paying for an NFL quarterback. That’s a bottleneck in the continued progress of artificial intelligence. And it’s not the only one. Even the top researchers can’t build these services without trial and error on an enormous scale. To build a deep neural network that cracks the next big AI problem, researchers must first try countless options that don’t work, running each one across dozens and potentially hundreds of machines.

“It’s almost like being the coach rather than the player,” says Demis Hassabis, co-founder of DeepMind, the Google outfit behind the history-making AI that beat the world’s best Go player. “You’re coaxing these things, rather than directly telling them what to do.”

That’s why many of these companies are now trying to automate this trial and error—or at least part of it. If you automate some of the heavily lifting, the thinking goes, you can more rapidly push the latest machine learning into the hands of rank-and-file engineers—and you can give the top minds more time to focus on bigger ideas and tougher problems. This, in turn, will accelerate the progress of AI inside the Internet apps and services that you and I use every day.

In other words, for computers to get smarter faster, computers themselves must handle even more of the grunt work. The giants of the Internet are building computing systems that can test countless machine learning algorithms on behalf of their engineers, that can cycle through so many possibilities on their own. Better yet, these companies are building AI algorithms that can help build AI algorithms. No joke. Inside Facebook, engineers have designed what they like to call an “automated machine learning engineer,” an artificially intelligent system that helps create artificially intelligent systems. It’s a long way from perfection. But the goal is to create new AI models using as little human grunt work as possible.

Feeling the Flow

After Facebook’s $104 billion IPO in 2012, Hussein Mehanna and other engineers on the Facebook ads team felt an added pressure to improve the company’s ad targeting, to more precisely match ads to the hundreds of millions of people using its social network. This meant building deep neural networks and other machine learning algorithms that could make better use of the vast amounts of data Facebook collects on the characteristics and behavior of those hundreds of millions of people.

According to Mehanna, Facebook engineers had no problem generating ideas for new AI, but testing these ideas was another matter. So he and his team built a tool called Flow. “We wanted to build a machine-learning assembly line that all engineers at Facebook could use,” Mehanna says. Flow is designed to help engineers build, test, and execute machine learning algorithms on a massive scale, and this includes practically any form of machine learning—a broad technology that covers all services capable of learning tasks largely on their own.

Basically, engineers could readily test an endless stream of ideas across the company’s sprawling network of computer data centers. They could run all sorts of algorithmic possibilities—involving not just deep learning but other forms of AI, including logistic regression to boosted decision trees—and the results could feed still more ideas. “The more ideas you try, the better,” Mehanna says. “The more data you try, the better.” It also meant that engineers could readily reuse algorithms that others had built, tweaking these algorithms and applying them to other tasks.

Soon, Mehanna and his team expanded Flow for use across the entire company. Inside other teams, it could help generate algorithms that could choose the links for your Faceboook News Feed, recognize faces in photos posted to the social network, or generate audio captions for photos so that the blind can understand what’s in them. It could even help the company determine what parts of the world still need access to the Internet.

With Flow, Mehanna says, Facebook trains and tests about 300,000 machine learning models each month. Whereas it once rolled a new AI model onto its social network every 60 days or so, it can now release several new models each week.

The Next Frontier

The idea is far bigger than Facebook. It’s common practice across the world of deep learning. Last year, Twitter acquired a startup, WhetLab, that specializes in this kind of thing, and recently, Microsoft described how its researchers use a system to test a sea of possible AI models. Microsoft researcher Jian Sun calls it “human-assisted search.”

Mehanna and Facebook want to accelerate this. The company plans to eventually open source Flow, sharing it with the world at large, and according to Mehanna, outfits like LinkedIn, Uber, and Twitter are already interested in using it. Mehanna and team have also built a tool called AutoML that can remove even more of the burden from human engineers. Running atop Flow, AutoML can automatically “clean” the data needed to train neural networks and other machine learning algorithms—prepare it for testing without any human intervention—and Mehanna envisions a version that could even gather the data on its own. But more intriguingly, AutoML uses artificial intelligence to help build artificial intelligence.

As Mehana says, Facebook trains and tests about 300,000 machine learning models each month. AutoML can then use the results of these tests to train another machine learning model that can optimize the training of machine learning models. Yes, that can be a hard thing to wrap your head around. Mehanna compares it to Inception. But it works. The system can automatically chooses algorithms and parameters that are likely to work. “It can almost predict the result before the training,” Mehanna says.

Inside the Facebook ads team, engineers even built that automated machine learning engineer, and this too has spread to the rest of the company. It’s called Asimo, and according to Facebook, there are cases where it can automatically generate enhanced and improved incarnations of existing models—models that human engineers can then instantly deploy to the net. “It cannot yet invent a new AI algorithm,” Mehanna says. “But who knows, down the road…”

It’s an intriguing idea—indeed, one that has captivated science fiction writers for decades: an intelligent machine that builds itself. No, Asimo isn’t quite as advanced—or as frightening—as Skynet. But it’s a step toward a world where so many others, not just the field’s sharpest minds, will build new AI. Some of those others won’t even be human.

Related Links:

Wednesday, April 27. 2016

And now Google enters the textile business: Project Jacquard | #textile #electronics #monitoring

Note: we blogged last week about automation and funilly, the Jacquard process was mentioned as one of the early stage of automation and computing during an exhibition in Wien. The "Métiers Jacquard" were an inspiration to Ch. Babbage when he started to design his Difference Engine, one of the early mechanic autonomous and programmable computer (in the sense of a calculator). We should also not forget that in reality, "computers" were real persons doing calculations -- often women (in particular during last world wars), which then became the first operators of automatic computers (see the ENIAC girls) -- until back in the middle of 20th century.

So to say, digital computers have already replaced "person computers" and automated, as well as by far quickened their activities... The first purpose of the computer as we know it was automation. It is part of its DNA.

Now, as a wink to this history but also as a possible "return of the repressed", Google literally enters the textile business and brings computing (back) to fabrics! So it is not by chance that they've picked up this name obviously, "Jacquard".

---

More about it on MIT Technology Review.

Related Links:

fabric | rblg

This blog is the survey website of fabric | ch - studio for architecture, interaction and research.

We curate and reblog articles, researches, writings, exhibitions and projects that we notice and find interesting during our everyday practice and readings.

Most articles concern the intertwined fields of architecture, territory, art, interaction design, thinking and science. From time to time, we also publish documentation about our own work and research, immersed among these related resources and inspirations.

This website is used by fabric | ch as archive, references and resources. It is shared with all those interested in the same topics as we are, in the hope that they will also find valuable references and content in it.

Quicksearch

Categories

Calendar

|

|

May '24 | |||||

| Mon | Tue | Wed | Thu | Fri | Sat | Sun |

| 1 | 2 | 3 | 4 | 5 | ||

| 6 | 7 | 8 | 9 | 10 | 11 | 12 |

| 13 | 14 | 15 | 16 | 17 | 18 | 19 |

| 20 | 21 | 22 | 23 | 24 | 25 | 26 |

| 27 | 28 | 29 | 30 | 31 | ||